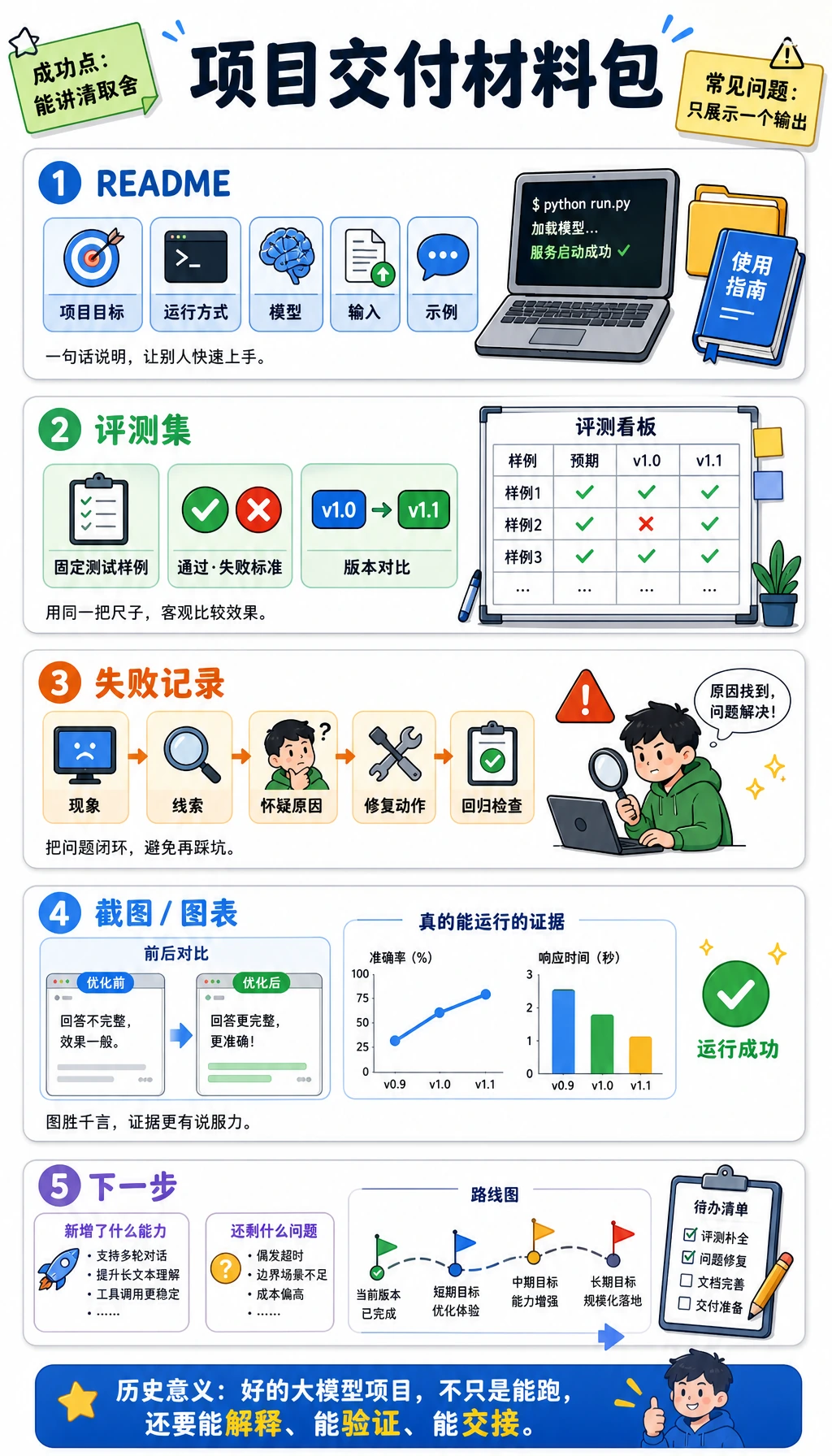

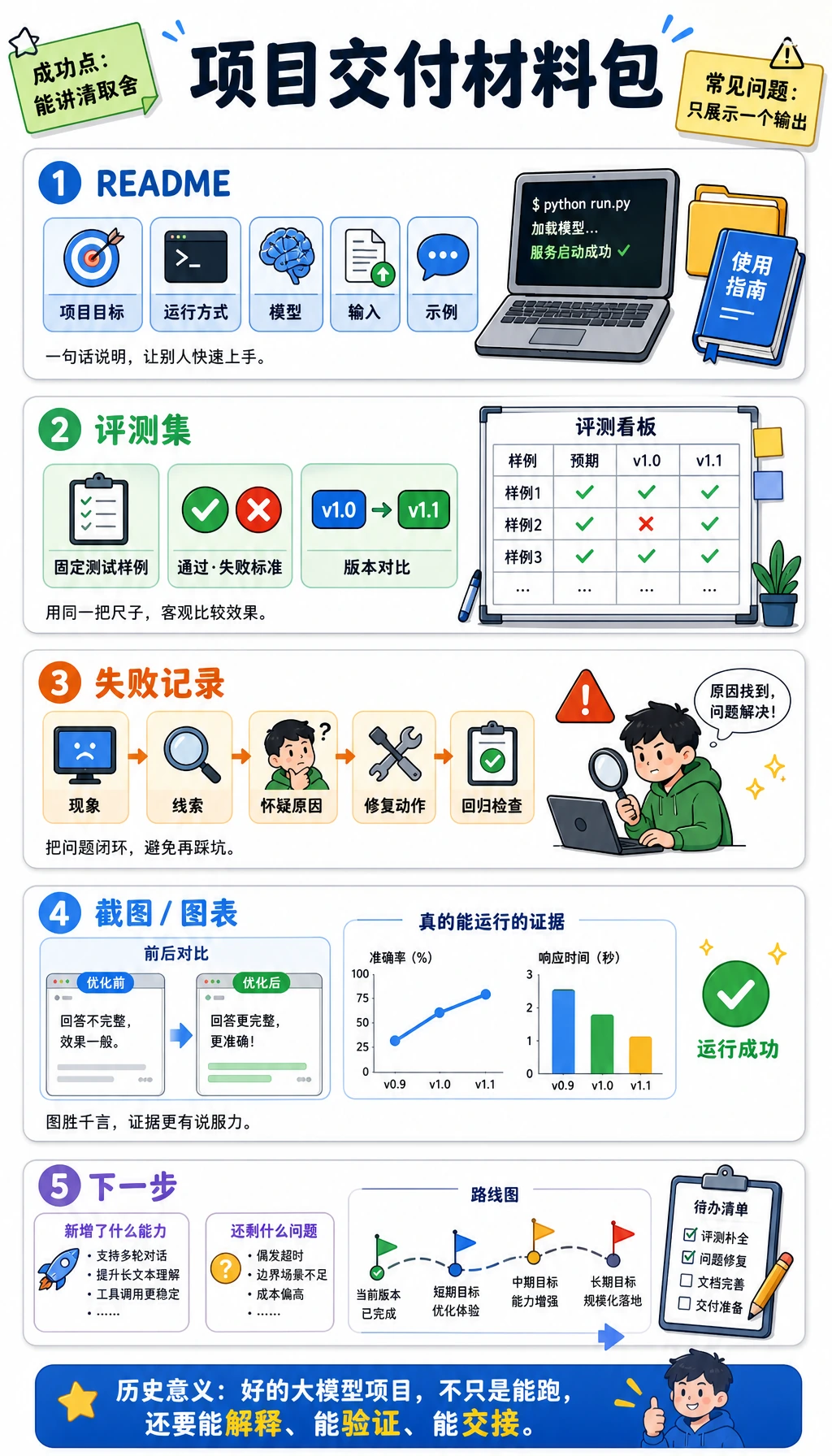

7.8.3 项目:交付材料包

一个大模型项目最后并不只是“能跑”。

更重要的是:

别人能不能看懂目标、复现结果、检查评测,并从你停下的地方继续做下去?

为什么要有这一页

很多项目不是模型不行,而是最后的交接不行。好的项目需要证据,而不只是演示。

最终包里应该有什么

一个合格的大模型项目包,至少应该包含:

README.md- 一条可复现的运行命令

- 示例输入和输出

- 评测记录

- 一条失败案例分析

- 截图或图表

- 后续计划

这是一套最小集合,能让项目自己站住。

最容易检查的目录结构

project/

├── README.md

├── examples/

│ ├── input-01.json

│ └── output-01.json

├── reports/

│ ├── evaluation.md

│ └── failure_cases.md

├── screenshots/

│ ├── run-01.png

│ └── before-after.png

└── src/

└── ...

这个结构故意做得很简单:

README.md负责讲故事examples/负责证明任务存在reports/负责证明评测做过screenshots/负责证明项目真的跑过

可以直接复用的 README 模板

把下面这个提纲复制走,再填入你自己的项目内容。

# 项目名称

## 1. 目标

这个项目解决什么问题?

## 2. 任务范围

什么在范围内,什么不在范围内?

## 3. 基线

你先和什么最简单的方法做了比较?

## 4. 数据

数据从哪里来?一共有多少样本?

## 5. 评测

你用了哪些指标或人工检查?

## 6. 结果

哪里变好了?哪里还不行?

## 7. 失败案例

展示一条真实失败,并解释原因。

## 8. 运行方式

别人怎样复现结果?

## 9. 后续计划

下一步你准备改什么?

一个实用的评测记录模板

如果你的项目有固定测试集,可以把结果整理成这样的表:

| 案例 ID | 输入 | 基线 | 新方法 | 是否通过 | 备注 |

|---|---|---|---|---|---|

| 001 | 退款请求 | 泛化回答 | 领域化回答 | 是 | 覆盖政策点 |

| 002 | 地址修改 | 太模糊 | 清晰规则回复 | 是 | 结构更完整 |

| 003 | 发票问题 | 漏掉关键细节 | 正确回答 | 否 | 需要更多数据 |

这样以后对比版本会很方便。

一个真正有用的失败笔记模板

不要只写“模型不好”。

要写成这样:

# 失败案例:JSON 字段缺失

- 现象:输出有时会在 JSON 前面多加一段解释。

- 线索:长提示词时更容易出现。

- 怀疑原因:Prompt 对输出格式约束不够强。

- 排查方式:对比不同 Prompt 版本,查看原始输出。

- 修复动作:增加严格的 schema 提醒和短示例。

- 回归检查:再跑一遍固定测试集。

一条这样的笔记,往往比十张截图更有价值。

好的交付长什么样

交付时,别人应该能很快回答三个问题:

- 这个项目解决什么问题?

- 我怎么复现它?

- 为什么这个方案比基线更好?

如果这三个问题都很容易回答,这个项目就适合放进作品集或团队评审。

最终检查清单

在关闭项目之前,检查这些项目:

- README 是否说明了目标和范围

- 运行命令是否可用

- 基线和新方法是否都有展示

- 评测集是否固定

- 是否至少有一条失败案例

- 是否有截图或图表

- 是否写了后续计划

总结

一个好的大模型项目,不只是一个能跑的脚本。

它还应该是一个可以被理解、被复现、被评测、被继续扩展的包。

当你能做到这些时,你就不只是“在学技术”了。 你是在做别人真的能接着用的东西。