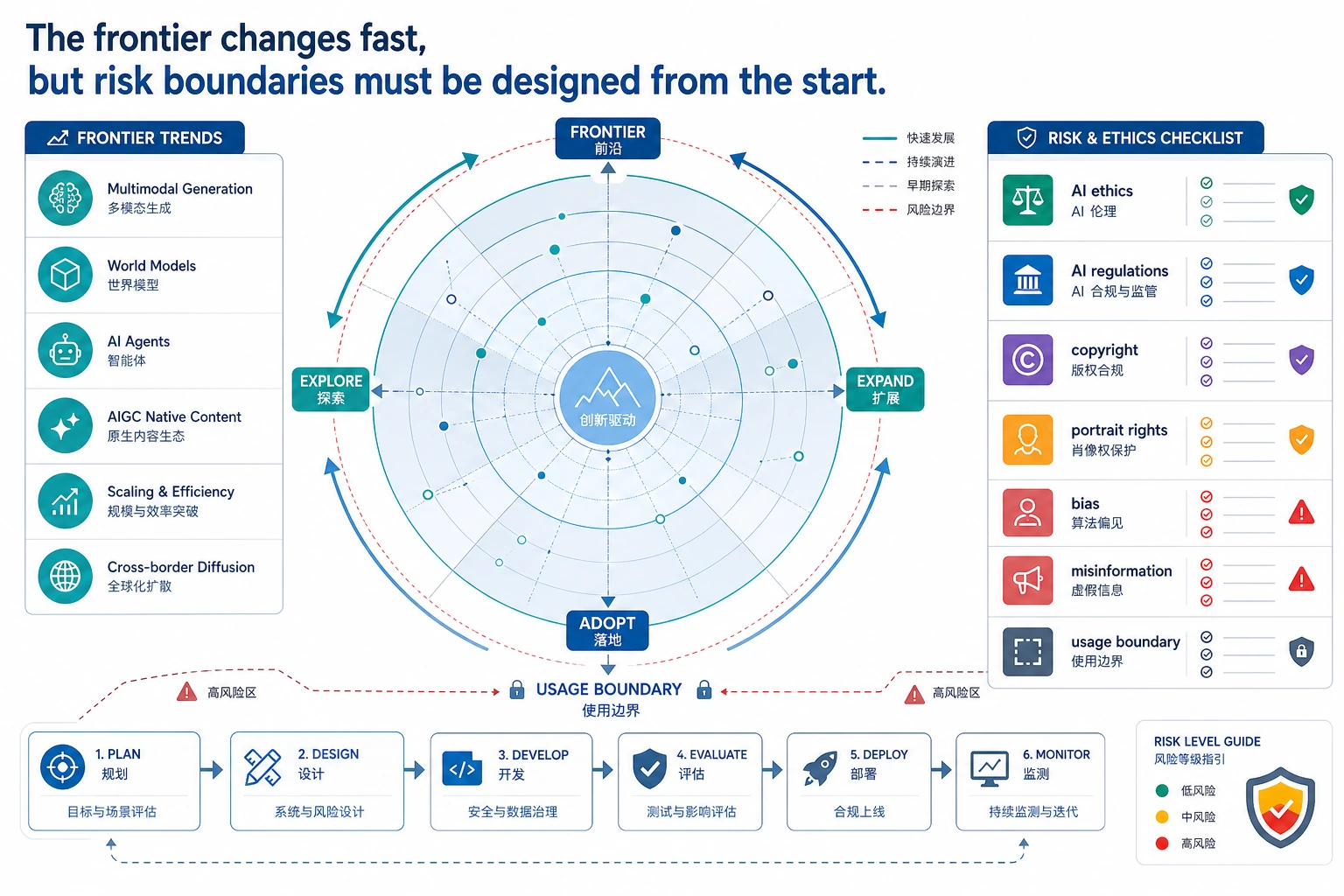

12.4.1 前沿与伦理路线图:发布前先看风险

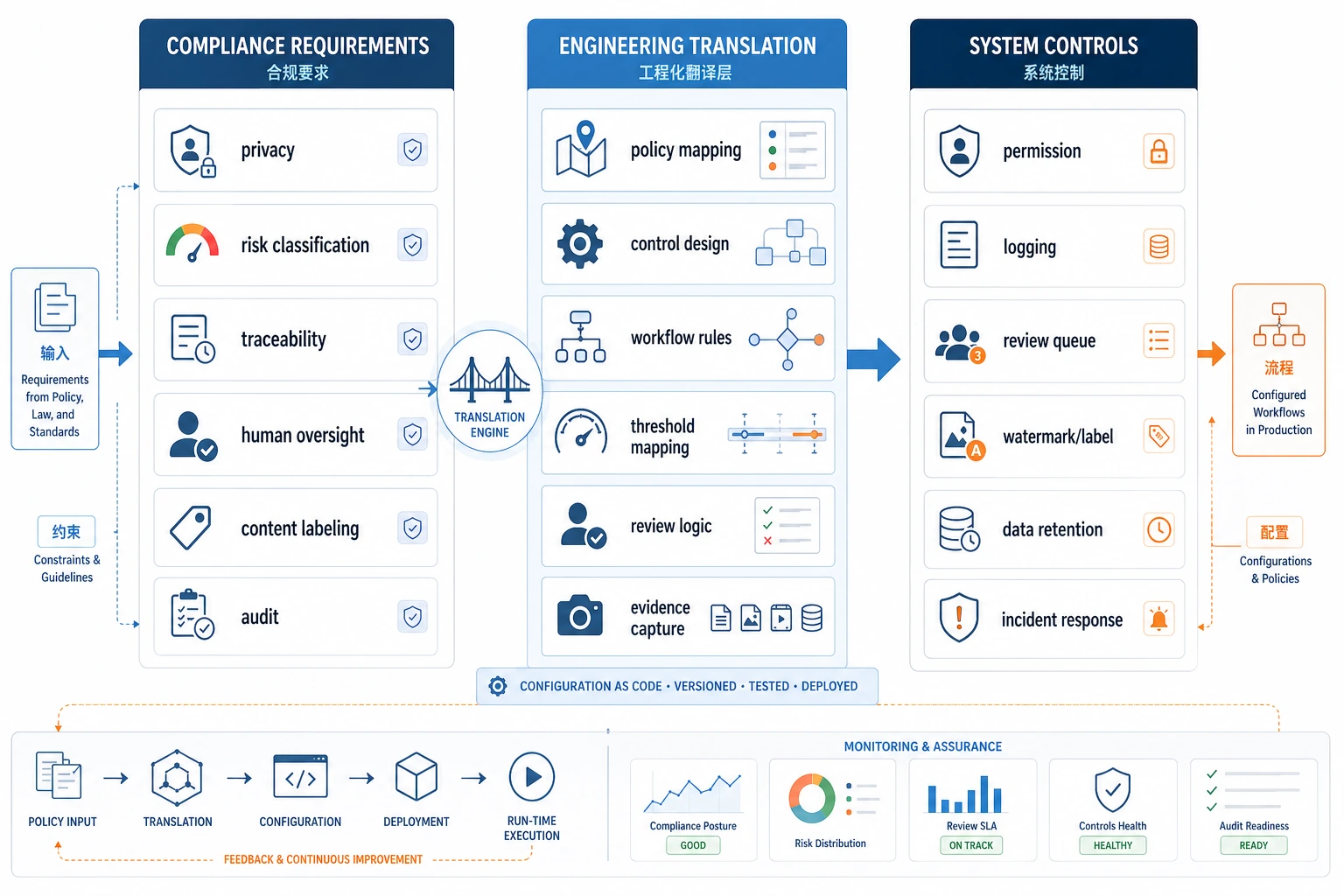

负责任的 AIGC 不是最后加一句免责声明,而是把素材来源、人物、声音、合成标识、敏感内容和人工审核放进导出前的工作流。

先看护栏

先养成一个习惯:哪些要拒绝,哪些要限制,哪些必须人工确认。

跑一个风险检查表

request = {

"uses_real_person": False,

"uses_cloned_voice": True,

"licensed_assets": True,

"synthetic_media": True,

}

checks = []

if request["uses_cloned_voice"]:

checks.append("voice authorization")

if request["synthetic_media"]:

checks.append("synthetic content label")

if not request["licensed_assets"]:

checks.append("asset license review")

decision = "human_review_required" if checks else "ready_to_export"

print("decision:", decision)

print("checks:", ", ".join(checks))

预期输出:

decision: human_review_required

checks: voice authorization, synthetic content label

这不是法律意见,而是工程检查表,用来尽早暴露产品风险。

按这个顺序学

| 步骤 | 阅读内容 | 练习产物 |

|---|---|---|

| 1 | 前沿趋势 | 说清能力变化和可能的产品影响 |

| 2 | 伦理与安全 | 映射版权、肖像、声音、偏见和虚假信息风险 |

| 3 | 法规与合规 | 把规则转成输入检查、审核步骤、标识和日志 |

通过标准

你能给一个 AIGC 工作流加上风险检查表,并解释哪些情况拒绝、限制、审核或允许导出,就算通过本章。