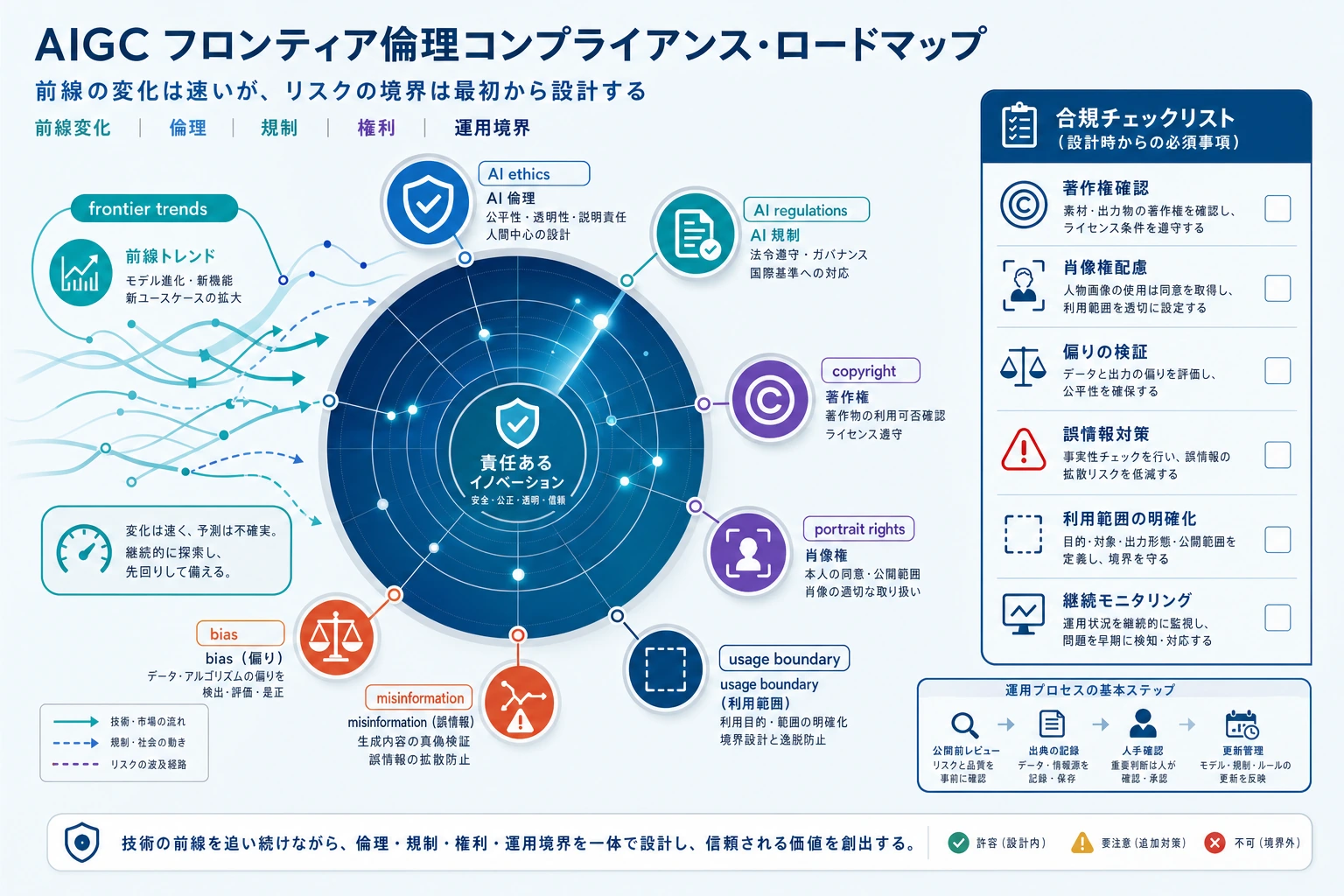

12.4.1 フロンティアと倫理ロードマップ:公開前にリスクを見る

責任ある AIGC は、最後に免責文を置くことではありません。素材の出所、人物、声、合成表示、センシティブな内容、人間のレビューを、出力前のワークフローに入れることです。

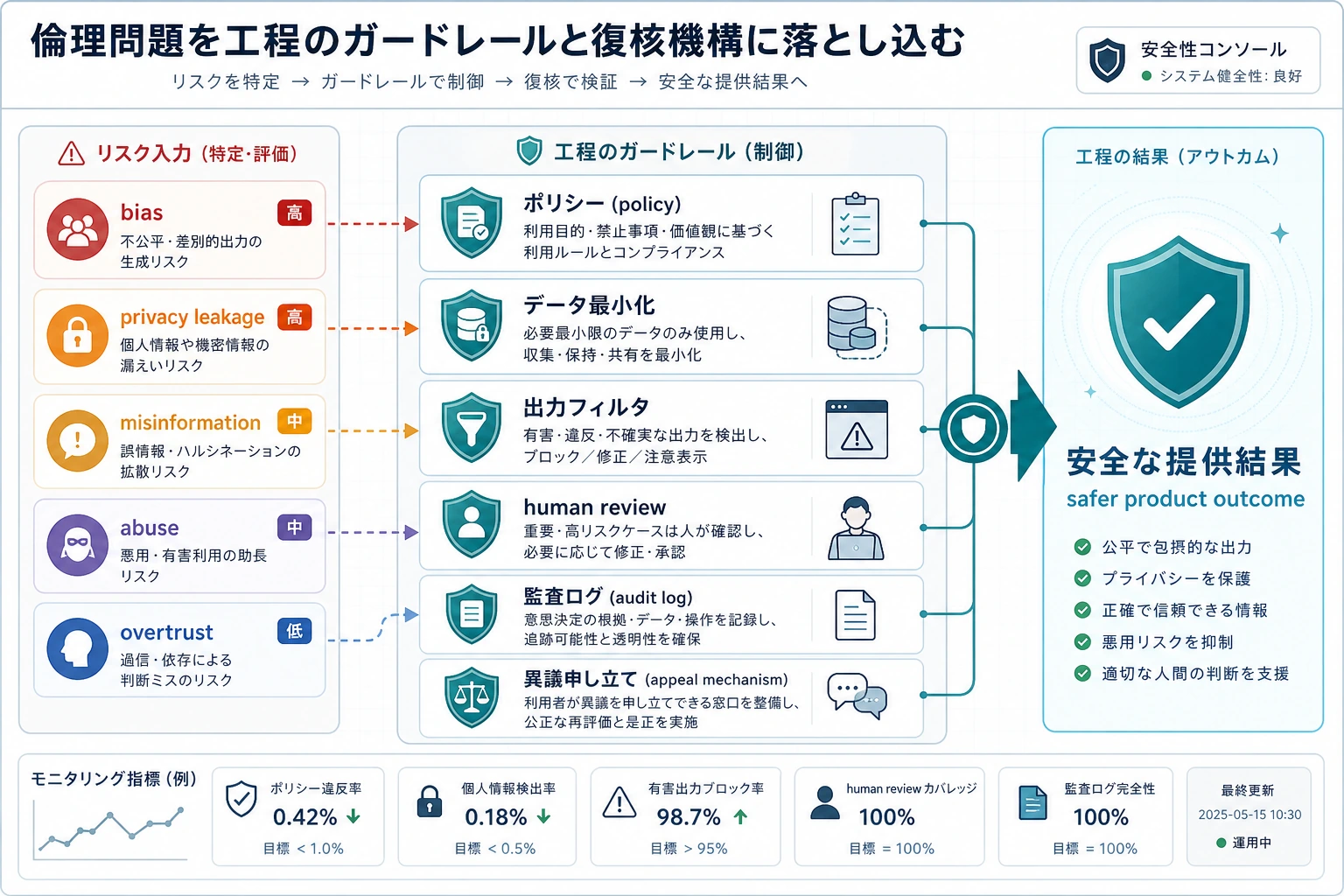

まずガードレールを見る

最初の習慣は、何を拒否し、何を制限し、何を人間が確認すべきかを考えることです。

リスクチェックリストを動かす

request = {

"uses_real_person": False,

"uses_cloned_voice": True,

"licensed_assets": True,

"synthetic_media": True,

}

checks = []

if request["uses_cloned_voice"]:

checks.append("voice authorization")

if request["synthetic_media"]:

checks.append("synthetic content label")

if not request["licensed_assets"]:

checks.append("asset license review")

decision = "human_review_required" if checks else "ready_to_export"

print("decision:", decision)

print("checks:", ", ".join(checks))

期待される出力:

decision: human_review_required

checks: voice authorization, synthetic content label

これは法的助言ではありません。プロダクトリスクを早い段階で見えるようにするためのエンジニアリング用チェックリストです。

この順番で学ぶ

| ステップ | 読む内容 | 練習の成果 |

|---|---|---|

| 1 | フロンティア動向 | 能力変化とプロダクトへの影響を説明する |

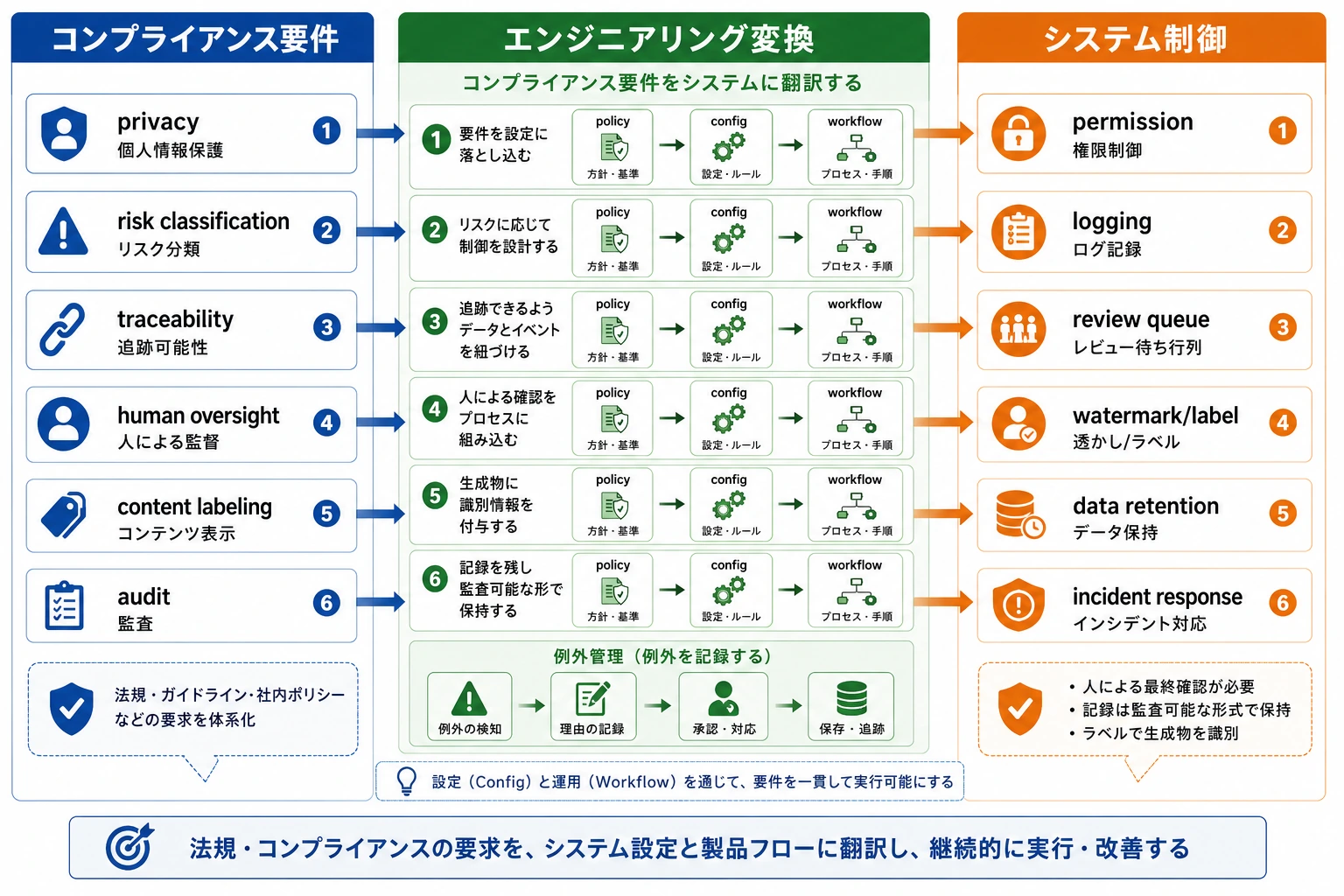

| 2 | 倫理と安全 | 著作権、肖像、声、偏り、誤情報のリスクを対応づける |

| 3 | 規制とコンプライアンス | ルールを入力チェック、レビュー、表示、ログへ変える |

通過条件

1 つの AIGC ワークフローにリスクチェックリストを追加し、拒否、制限、レビュー、出力可能の判断を説明できれば、この章は通過です。