5.6.1 機械学習プロジェクトロードマップ:baseline、証拠、改善

この小章は第5章の出口です。データ問題を、評価でき、説明でき、ポートフォリオに見せられるモデリングフローへ変えられることを確認します。

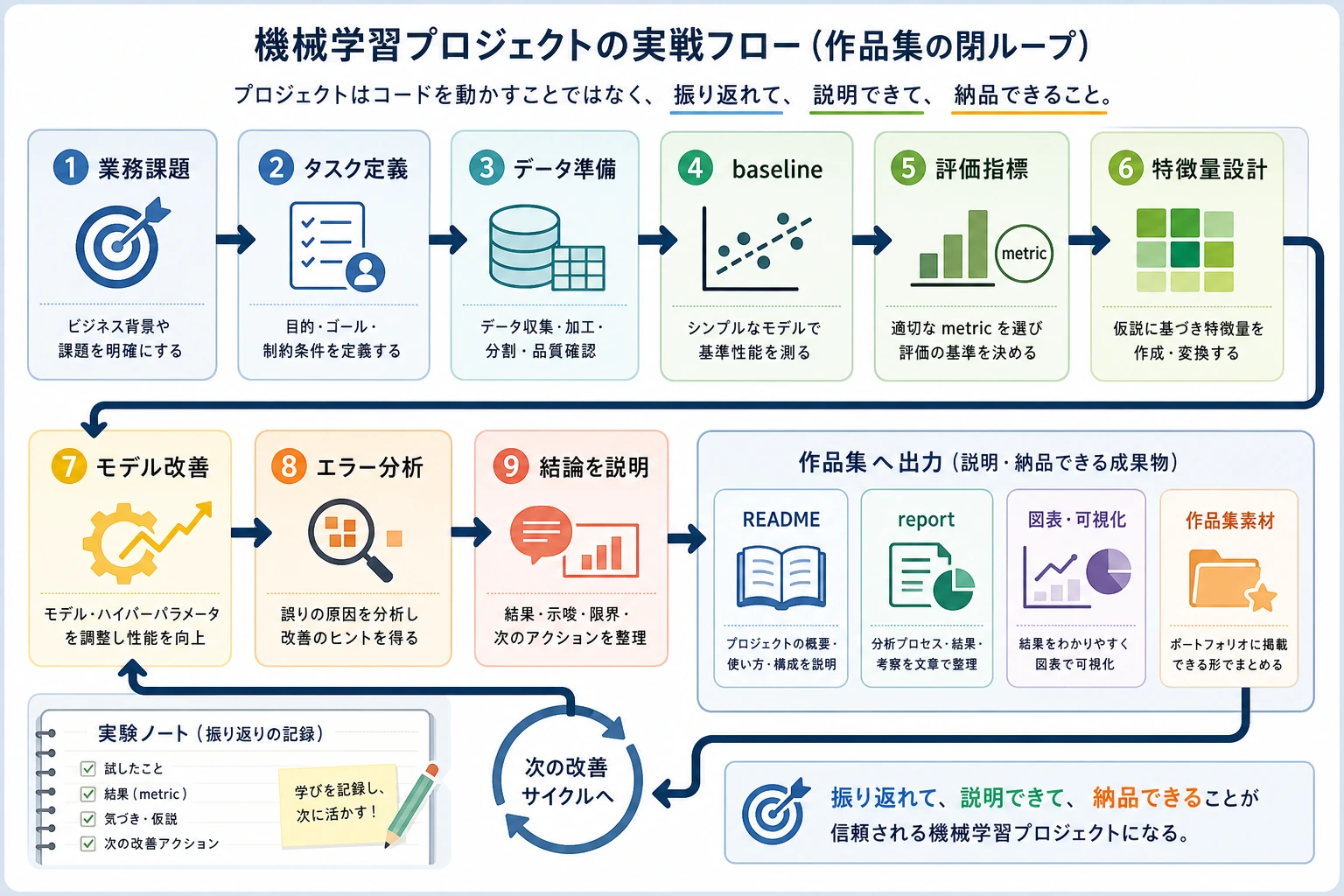

まずプロジェクトループを見る

このプロジェクトループを覚えます。

問題 -> データ -> baseline -> 指標 -> 改善 -> 失敗例 -> レポート

いきなり複雑なモデルに進まないでください。baseline、指標、失敗分析がないプロジェクトは、ただの demo 実行になりがちです。

実験ログを1つ残す

ml_project_log_first_loop.py を作ります。これはモデルではなく、すべてのモデルプロジェクトに必要な習慣です。

experiments = [

{"version": "v1_baseline", "metric": 0.72, "change": "default model"},

{"version": "v2_features", "metric": 0.78, "change": "add ratio features"},

{"version": "v3_tuned", "metric": 0.80, "change": "tune max_depth"},

]

best = max(experiments, key=lambda row: row["metric"])

print("best_version:", best["version"])

print("best_metric:", best["metric"])

print("next_step: inspect failure cases before adding more models")

出力:

best_version: v3_tuned

best_metric: 0.8

next_step: inspect failure cases before adding more models

ここでの変化は、「モデルを動かした」から「バージョンを比較し、次の一手を説明できる」へ移ることです。

この順番で学ぶ

| 順番 | 読む | 提出するもの |

|---|---|---|

| 1 | 5.6.2 住宅価格予測 | 回帰 baseline と改善 |

| 2 | 5.6.3 顧客離脱予測 | 分類指標としきい値の考え方 |

| 3 | 5.6.4 ユーザーセグメンテーション | クラスタ解釈と業務ラベル |

| 4 | 5.6.5 Kaggle 実践 | 実際の提出フロー |

| 5 | 5.6.6 ML 実践ワークショップ | 完全な証拠パックの練習 |

ワークショップを最後に置くのは、前のプロジェクト習慣を再現可能な証拠パックにまとめるためです。

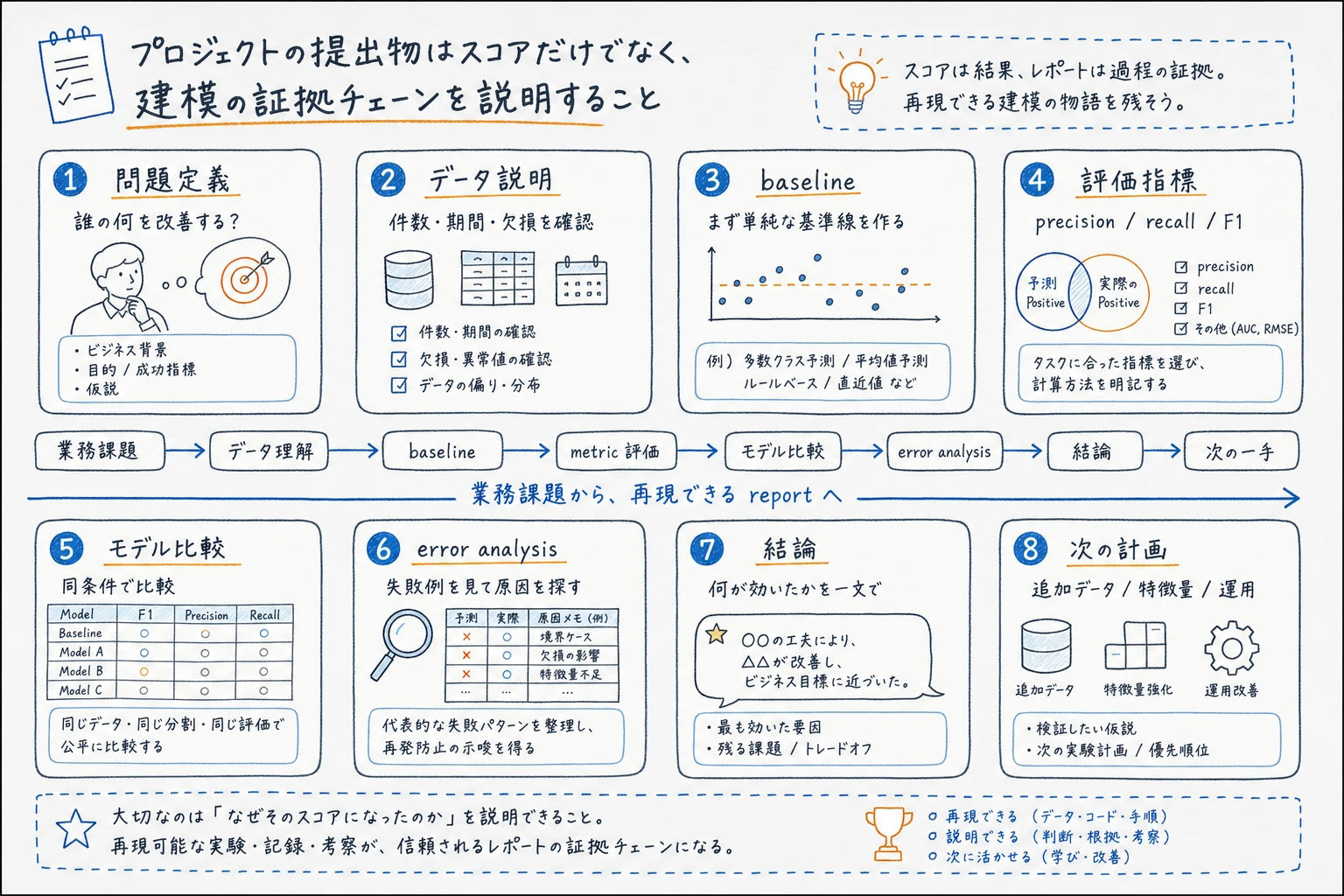

プロジェクト成果物基準

少なくとも1つのプロジェクトで、README.md、実行コマンド、指標表、実験ログ、失敗例1つ、グラフ1つ、次の改善案を残します。

合格ライン

タスクをどう定義したか、どの baseline を使ったか、どの指標を信頼したか、何が改善したか、どこで失敗したか、次に何をするかを説明できれば合格です。